- AI의 '거짓말' 또는 '환각' 문제를 해결하기 위해 모르는 것을 모른다고 학습시키는 새로운 강화 미세 조정 방식인 RFT(Reinforcement Fine-Tuning)가 등장했습니다. 🤥

- RFT는 AI가 잘못된 답변을 할 경우 페널티를 부여하여, 모르는 정보에 대해 자신감 있게 틀린 답을 내놓는 경향을 줄이는 것을 목표로 합니다. 🎓

- 이 기술은 서던 캘리포니아 대학교에서 연구되었으며, 특히 중국 연구자들의 활약이 두드러져 AI 기술 분야에서의 중국의 영향력을 보여줍니다. 🇨🇳

- RFT는 질문이 불완전하거나 오해의 소지가 있을 때 모델이 침묵 대신 잘못된 답을 내놓는 경향이 여전히 존재하며, 답하지 않은 것에 대한 보상이 없다는 한계가 있습니다. 🚧

- 이러한 새로운 학습법의 등장은 AI가 생성하는 정보의 신뢰도를 높여, 사용자들이 AI의 말을 맹목적으로 믿기 어려운 현재의 문제를 개선할 것으로 기대됩니다. ✨

- AI 시장의 변화를 이해하고 새로운 기술 동향을 지속적으로 리서치하는 것이 중요하며, 관련 기술 논문을 꾸준히 읽는 것을 권장합니다. 📚

- 대형 언어 모델(LLM) 분야에서 중국 연구자들의 뛰어난 기술력과 활발한 연구 활동이 강조되며, 한국도 이 분야에서 더 많은 노력이 필요하다는 아쉬움이 언급됩니다. 🚀

- AI 분야는 매달 수백 개의 논문이 쏟아져 나올 정도로 빠르게 발전하고 있으며, 다양한 세분화된 장르에서 지속적인 관심과 학습이 필요합니다. 🌊

Recommanded Videos

Gemini's 3 New Models

2024. 8. 28.

Beyond the Basics: Unlocking UEFN with an Unreal Mindset | Unreal Fest Stockholm 2025

2025. 12. 18.

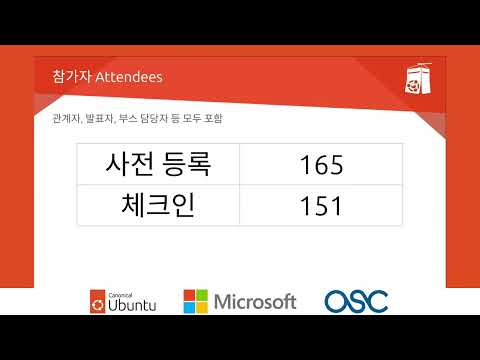

UbuCon Korea 2023 폐회사

2024. 3. 24.

타입스크립트 교과서 사야하나요?? 쇼트로 다 알려주는 거 아니에요?

2024. 8. 18.

Step‑by‑Step Password Hashing in Python with Bcrypt – Secure & Practical

2025. 7. 3.

기획자-PO 이직/포트폴리오 가이드 4.경력서 및 포트폴리오 작성 방법

2025. 7. 31.