- Kimi K2는 Moonshot AI에서 개발한 모델로, Agentic Intelligence에 초점을 맞추어 툴 사용 능력을 향상시키는 데 중점을 둠. 🚀

- DeepSeek V3 및 Claude Opus와 비교했을 때 벤치마크 성능이 우수하며, 특히 agent 워크플로우 개선에 기여함. 🥇

- 1조 개의 파라미터와 15.5조 개의 토큰을 사용하여 사전 훈련되었으며, 이는 매우 큰 규모임. 🤯

- MuonClip이라는 새로운 Optimizer를 도입하여 훈련 안정성을 높이고, 토큰 효율성을 향상시킴. 💡

- 데이터셋의 품질을 개선하기 위해 LLM을 활용한 데이터 재구성(rephrasing) 파이프라인을 구축함. ✍️

- 지식 데이터 재구성을 통해 동일한 내용을 다양한 스타일로 변환하여 데이터셋의 다양성을 확보함. 🎭

- 수학 데이터에 대해서는 학습 노트 스타일로 재작성하여 LLM의 논리적 능력을 강화함. ➕

- 웹 텍스트, 코드, 수학, 지식의 4가지 주요 도메인에서 고품질 데이터를 큐레이션하여 사용함. 📚

- Kimi K2의 모델 아키텍처는 DeepSeek V3의 설계를 거의 그대로 복사한 것으로 보임. 🏗️

- 데이터 양이 매우 크기 때문에 차원 축소를 통한 잠재적 주의(latent attention)를 수행하여 KV 캐시 부분의 차원을 크게 줄임. 📉

Recommanded Videos

React just got hacked, and it's worse than you think...

2025. 12. 11.

SvelteKit Remote Functions tips: Auth guards, managing async, query.batch

2025. 9. 24.

개인정보유출사고, 벌금 누구 줘야할까? | 왜 나라가 가져감? 피해자는 난데?

2025. 3. 31.

LG엔솔의 배터리, SpaceX 인류 역사상 최대 우주선 스타십에 공급이 가지는 의미 | 품질 기준 훨씬 높은 배터리 제조 통과 | 고열, 고압, 고진동에 견디는 배터리 퀄리티

2024. 11. 11.

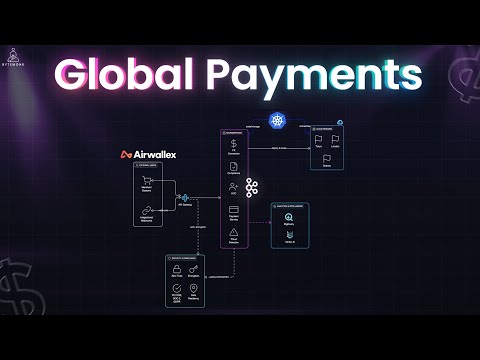

How Global Payments Actually Work (and How to Save on FXFees with Airwallex)

2025. 9. 6.

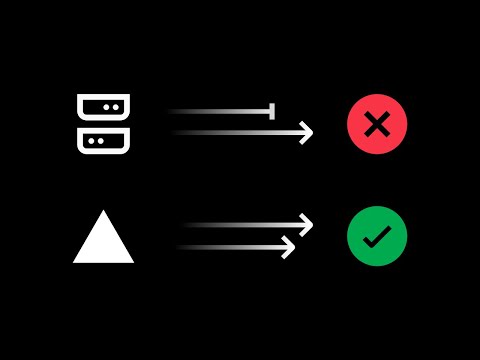

Deploy without breaking existing apps

2024. 6. 17.