카카오

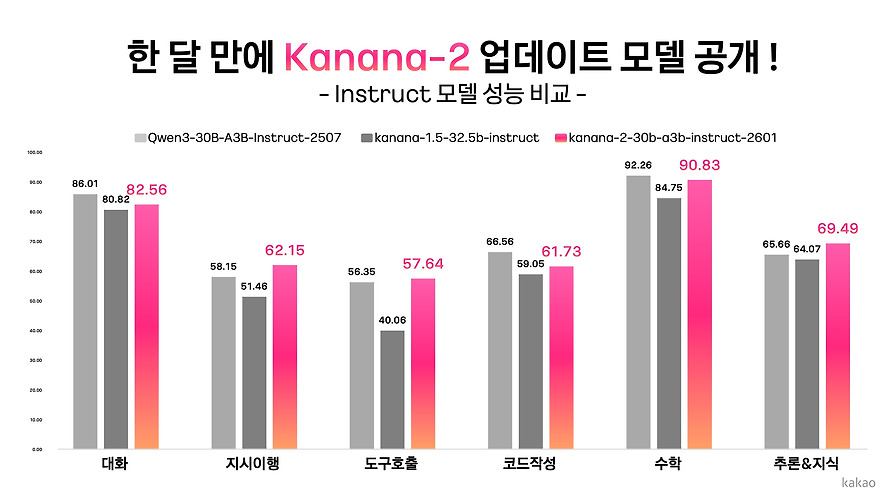

Kanana-2 개발기 (2): 개선된 post-training recipe를 중심으로

카카오의 Kanana-2 LLM은 Mid-training, Parallel RL, Calibration Tuning 등 개선된 Post-training 레시피를 통해 Agentic AI 핵심 역량을 강화하고 성능을 극대화했다.

Mid-training * Pre-training과 Post-training 사이의 추가 단계로, 추론 능력 강화 및 Agentic AI 기반 다지기. * 200B 토큰 규모의 수학, 코드, 툴 추론 데이터셋 구축 및 치명적 망각 방지를 위한 Pre-training 데이터 리플레이. * 수학/코딩 성능 향상 및 기존 언어 능력 유지, SFT 이후 성능 시너지. Instruct 모델 * Agentic AI 핵심인 Instruction Following 및 Tool Calling 능력 극대화 목표. * 멀티턴 IF/Tool Calling 데이터셋 제작 및 Parallel RL 도입. * Linear Merging 후 Calibration Tuning으로 통합 모델 성능 복원. Thinking 모델 * 심층 추론, 고난이도 한국어 답변, IF/Tool Calling 능력 강화. * 고품질 Thinking SFT 데이터 엄선, '한국어 질문 → 영어 사고 과정 → 한국어 답변' 구조. * Parallel RL 및 Calibration Tuning으로 통합 모델 성능 복원.

Next Feeds

FE News 26년 1월 소식을 전해드립니다!

네이버 FE News 26년 1월호는 RSC 시각화 도구, 클라이언트 사이드 AI 트렌드, 디자인시스템과 AI 활용 마크업 자동화 소식을 다룹니다.

엔터프라이즈 LLM 서비스 구축기 1: 컨텍스트 엔지니어링

LY Corporation의 Flava AI 어시스턴트 구축 과정에서 LLM 성능 향상을 위한 컨텍스트 엔지니어링 전략과 '점진적 공개' 방식을 상세히 설명합니다.

꺼진 광고 매출 다시 보자

알라미는 광고를 '제품'처럼 운영하여 인앱 광고 매출 최고치를 경신했으며, 이 노하우를 담은 수익화 솔루션 DARO를 통해 다른 앱들의 지속적인 광고 매출 성장을 돕는다.

TwelveLabs Marengo를 활용한 Amazon Bedrock에서의 영상 이해 기술 구현

Amazon Bedrock과 TwelveLabs Marengo를 활용한 멀티모달 비디오 이해 및 교차 모달 검색 솔루션 구현.

Claude Code 컨텍스트 최적화 가이드

Claude Code 사용 시 LLM의 컨텍스트 부패를 방지하고 코드 품질을 높이기 위한 4가지 최적화 방법을 제시한다.

Strands Agent SOPs 소개 – AI 에이전트를 위한 자연어 워크플로우

AI 에이전트의 일관성 및 신뢰성 문제를 해결하기 위해 자연어 기반의 표준화된 마크다운 워크플로우인 Agent SOPs를 소개하고 활용법을 설명합니다.