- AI는 잘못된 정보라도 매우 확신에 찬 답변을 제공할 수 있습니다. 🤖

- AI 환각(Hallucination)은 AI가 사실이 아닌 정보를 사실처럼 제시하는 현상입니다. 👻

- 환각의 주요 원인은 부적절한 훈련 데이터나 특정 키워드(예: '성공')로 인한 답변 편향입니다. 📚

- AI 모델은 불확실성을 표현하지 못하고 항상 100% 확신하는 것처럼 보일 수 있습니다. 💯

- 환각을 개선하기 위해 모델 수준에서 낮은 신뢰도일 경우 '확실하지 않음'을 표명하거나 답변을 거부하도록 설정할 수 있습니다. 🛠️

- 사용자는 AI에게 불확실성을 표현하고 이유를 설명하도록 지시하거나, 사실 확인 및 출처를 요청할 수 있습니다. 🗣️

- 동일한 질문을 여러 번 반복하여 답변의 일관성을 확인하고, 여러 AI 모델을 교차 참조하여 신뢰도를 높일 수 있습니다. 🔄

Recommanded Videos

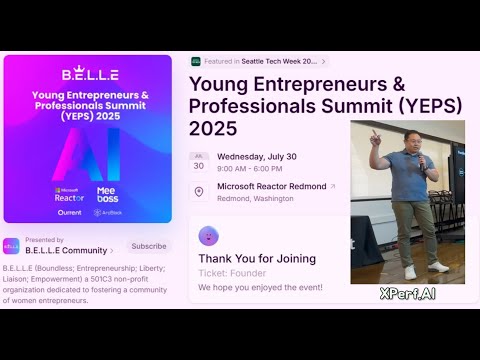

YEPS 2025 (Seattle Tech Week) XPerf.ai - AI-based GPU Utilization Booster

2025. 10. 4.

Let's Get ICED! Learning Rust Live

2023. 7. 15.

군대에서 개발 공부하고 싶다면 이걸 하세요

2025. 5. 30.

Top 10 Rest API Design Pitfalls by Victor Rentea @ Spring I/O 2025

2025. 9. 3.

The Easiest Way to Use Custom Fonts

2024. 9. 15.

![📱 Publish Flutter App to App Store [2025]](https://i3.ytimg.com/vi/f-BCtQWfWJ8/hqdefault.jpg)

📱 Publish Flutter App to App Store [2025]

2025. 5. 14.